Beruflich Dokumente

Kultur Dokumente

Is.S3.C2.D1-Componentes BI (I) V0.2

Hochgeladen von

TonyPsCopyright

Verfügbare Formate

Dieses Dokument teilen

Dokument teilen oder einbetten

Stufen Sie dieses Dokument als nützlich ein?

Sind diese Inhalte unangemessen?

Dieses Dokument meldenCopyright:

Verfügbare Formate

Is.S3.C2.D1-Componentes BI (I) V0.2

Hochgeladen von

TonyPsCopyright:

Verfügbare Formate

V02

SAPBI Mster en Consultora Business

Intelligence SAP

IS - Introduccin a SAP y Business Intelligence

Sesin 3- Introduccin a Business Intelligence

Clase 2- Componentes de BI (I)

(8 Videos)

IS.S3.C2.D1

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 1

Business Intelligence SAP Business Intelligence

CONTENIDO Sesin 3. Clase 2. Componentes de BI (I)

Videos

1. Esquema de BI >IS.S3.C2.V1<

2. Fuentes de datos >IS.S3.C2.V2<

3. Procesos ETL >IS.S3.C2.V3<

4. Procesos ETL - Extraccin >IS.S3.C2.V4<

5. Procesos ETL Limpieza >IS.S3.C2.V5<

6. Procesos ETL Transformacin >IS.S3.C2.V6<

7. Procesos ETL - Carga >IS.S3.C2.V7<

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 2

Business Intelligence SAP Business Intelligence

CONTENIDO Sesin 3. Clase 2. Componentes de BI (I)

Videos

1. Esquema de BI >IS.S3.C2.V1<

2. Fuentes de datos >IS.S3.C2.V2<

3. Procesos ETL >IS.S3.C2.V3<

4. Procesos ETL - Extraccin >IS.S3.C2.V4<

5. Procesos ETL Limpieza >IS.S3.C2.V5<

6. Procesos ETL Transformacin >IS.S3.C2.V6<

7. Procesos ETL - Carga >IS.S3.C2.V7<

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 3

Business Intelligence SAP Business Intelligence

Vdeo 1. Esquema de BI

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 4

Business Intelligence SAP Business Intelligence

FINAL VIDEO 1

Esquema de BI

IS - Introduccin a SAP y Business Intelligence

Sesin 03 Introduccin a Business Intelligence

Clase 2 Componentes de BI (I)

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 5

Business Intelligence SAP Business Intelligence

CONTENIDO Sesin 3. Clase 2. Componentes de BI (I)

Videos

1. Esquema de BI >IS.S3.C2.V1<

2. Fuentes de datos >IS.S3.C2.V2<

3. Procesos ETL >IS.S3.C2.V3<

4. Procesos ETL - Extraccin >IS.S3.C2.V4<

5. Procesos ETL Limpieza >IS.S3.C2.V5<

6. Procesos ETL Transformacin >IS.S3.C2.V6<

7. Procesos ETL - Carga >IS.S3.C2.V7<

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 6

Business Intelligence SAP Business Intelligence

Vdeo 2. Fuentes de datos

Fuentes de datos

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 7

Business Intelligence SAP Business Intelligence

Vdeo 2. Fuentes de datos

Se considera fuente de datos cualquier sistema o fichero el

cual utilicemos para extraer datos. Las fuentes de datos a las

que podemos acceder pueden ser internas o externas:

Fuentes internas:

Sistemas operacionales o transaccionales,

que incluyen aplicaciones desarrolladas a

medida, ERP, CRM, SCM, etc.

Sistemas de informacin departamentales:

previsiones, presupuestos, hojas de clculo,

etctera.

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 8

Business Intelligence SAP Business Intelligence

Vdeo 2. Fuentes de datos

Fuentes externa, en algunos casos comprada a terceros,

como por ejemplo estudios de mercado (Nielsen en

distribucin de gran consumo, IMS de la industria

farmacutica). Las fuentes de informacin externas son

fundamentales para enriquecer la informacin que tenemos

de nuestros clientes. En algunos casos es interesante

incorporar informacin referente, por ejemplo, a poblacin,

nmero de habitantes, etc. Podemos acceder a informacin

de este tipo en la web del Instituto Nacional de Estadstica

(www.ine.es). En esta categora tambin es importante

destacar el uso cada vez ms habitual de la informacin

presente en internet: redes sociales, blogs, etc.

Toda la informacin recogida a travs de las fuentes de datos, es informacin propia de cada sistema,

por lo que es necesario procesarla para transformarla en un formato homogneo que permita la

trazabilidad con los datos de otros sistemas ya sean internos o externos. Para ello se utilizan los

procesos ETL.

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 9

Business Intelligence SAP Business Intelligence

FINAL VIDEO 2

Fuentes de datos

IS - Introduccin a SAP y Business Intelligence

Sesin 03 Introduccin a Business Intelligence

Clase 2 Componentes de BI (I)

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 10

Business Intelligence SAP Business Intelligence

CONTENIDO Sesin 3. Clase 2. Componentes de BI (I)

Videos

1. Esquema de BI >IS.S3.C2.V1<

2. Fuentes de datos >IS.S3.C2.V2<

3. Procesos ETL >IS.S3.C2.V3<

4. Procesos ETL - Extraccin >IS.S3.C2.V4<

5. Procesos ETL Limpieza >IS.S3.C2.V5<

6. Procesos ETL Transformacin >IS.S3.C2.V6<

7. Procesos ETL - Carga >IS.S3.C2.V7<

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 11

Business Intelligence SAP Business Intelligence

Vdeo 3. Procesos ETL

Procesos ETL

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 12

Business Intelligence SAP Business Intelligence

Vdeo 3. Procesos ETL

Procesos ETL

Un proceso ETL (Extract, Transform and Load), tal y

como sus siglas indican, es el paso encargado de

extraer todos los datos necesarios de cada una de las

fuentes de datos, para tratarlos y conseguir datos

homogneos de calidad, para finalmente cargarlos en

un sistema de almacenamiento de datos.

EXTRACT TRANSFORM LOAD

Esta parte del sistema de BI es costosa y consume una parte significativa de todo el proceso, ya que

condiciona el xito posterior de las herramientas de BI, por ello requiere recursos, estrategia,

habilidades especializadas y tecnologas. Es la parte del sistema de BI ms crtica ya que si no

se disea correctamente, el resto de partes trabajaran sobre informacin errnea o con datos

de baja calidad que provocar sobresfuerzos innecesarios.

El proceso de ETL consume entre el 60% y el 80% del tiempo de un proyecto de Business

Intelligence, por lo que es un proceso clave en la vida de todo proyecto.

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 13

Business Intelligence SAP Business Intelligence

Vdeo 3. Procesos ETL

Procesos ETL

El proceso ETL se divide en 4 subprocesos:

EXTRACT CLEAN TRANSFORM LOAD

1. Extraccin: Subproceso encargado de recupere los datos fsicamente de las distintas fuentes

de datos. Al final de este subproceso disponemos de los datos en bruto.

2. Limpieza: Se recuperan los datos en bruto y comprueba su calidad, elimina los duplicados y,

cuando es posible, corrige los valores errneos y completa los valores vacos, es decir se

transforman los datos para reducir los errores de carga. En este momento disponemos de datos

limpios y de calidad*.

3. Transformacin: Recupera los datos limpios y de calidad, y los estructura y consolida en los

distintos modelos de anlisis. El resultado de este proceso es la obtencin de datos limpios,

consistentes, consolidados y tiles.

4. Carga: Este subproceso valida que los datos que cargamos en el datawarehouse sean

consistentes con las definiciones y formatos del datawarehouse; los integra en los distintos

modelos de las distintas reas de negocio que hemos definido en el mismo.

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 14

Business Intelligence SAP Business Intelligence

FINAL VIDEO 3

Procesos ETL

IS - Introduccin a SAP y Business Intelligence

Sesin 03 Introduccin a Business Intelligence

Clase 2 Componentes de BI (I)

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 15

Business Intelligence SAP Business Intelligence

CONTENIDO Sesin 3. Clase 2. Componentes de BI (I)

Videos

1. Esquema de BI >IS.S3.C2.V1<

2. Fuentes de datos >IS.S3.C2.V2<

3. Procesos ETL >IS.S3.C2.V3<

4. Procesos ETL - Extraccin >IS.S3.C2.V4<

5. Procesos ETL Limpieza >IS.S3.C2.V5<

6. Procesos ETL Transformacin >IS.S3.C2.V6<

7. Procesos ETL - Carga >IS.S3.C2.V7<

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 16

Business Intelligence SAP Business Intelligence

Vdeo 4. Procesos ETL - Extraccin

El principal objetivo de la extraccin es extraer tan slo aquellos datos de los sistemas

transaccionales que son necesarios y prepararlos para el resto de los subprocesos de ETL.

Para ello se deben determinar las mejores fuentes de informacin, las de mejor calidad. Con tal

finalidad, deberemos analizar las fuentes disponibles y escoger aquellas que sean mejores.

La primera parte del proceso ETL consiste en localizar y extraer los datos, ya que en la mayora de

proyectos de BI se fusionan datos provenientes de diferentes fuentes de datos. Los formatos de las

fuentes estn condicionados al modelado de datos del sistema de informacin al que pertenecen. La

extraccin convierte los datos a un formato homogneo y consolidado para iniciar el proceso

de transformacin.

Una parte intrnseca del proceso de extraccin es la de analizar los datos extrados, de lo que

resulta un chequeo que verifica si los datos cumplen la pauta o estructura que se esperaba. De no

ser as los datos son rechazados. De ah que sea clave disponer de datos de calidad ya en el origen,

la fuente de datos.

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 17

Business Intelligence SAP Business Intelligence

Vdeo 4. Procesos ETL - Extraccin

La extraccin de los datos se puede realizar bien de forma manual o bien utilizando herramientas de

ETL:

Manual: significa programar rutinas utilizando lenguajes de programacin que extraigan los

datos de las fuentes de datos origen, aunque en otros casos se opta por las utilidades de replicar

la base de datos que tienen los motores de bases de datos.

Automatizada: La alternativa ms rentable es la que proveen las herramientas

especializadas de ETL, ya que han sido diseadas para llevar a cabo esta funcin y nos

permiten visualizar el proceso y detectar los errores durante el proceso o durante la carga.

Los principales problemas que nos podemos encontrar al acceder a los datos para extraerlos:

provienen de distintas fuentes, BBDD, plataformas tecnolgicas, protocolos de comunicaciones,

juegos de caracteres, y tipos de datos.

Un requerimiento importante que se debe exigir a la tarea de extraccin es que sta cause un

impacto mnimo en el sistema origen. Si los datos a extraer son muchos, el sistema de origen se

podra ralentizar e incluso colapsar, provocando que ste no pueda utilizarse con normalidad para

su uso cotidiano. Por esta razn, en sistemas grandes las operaciones de extraccin suelen

programarse en horarios o das donde este impacto sea nulo o mnimo.

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 18

Business Intelligence SAP Business Intelligence

FINAL VIDEO 4

Procesos ETL - Extraccin

IS - Introduccin a SAP y Business Intelligence

Sesin 03 Introduccin a Business Intelligence

Clase 2 Componentes de BI (I)

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 19

Business Intelligence SAP Business Intelligence

CONTENIDO Sesin 3. Clase 2. Componentes de BI (I)

Videos

1. Esquema de BI >IS.S3.C2.V1<

2. Fuentes de datos >IS.S3.C2.V2<

3. Procesos ETL >IS.S3.C2.V3<

4. Procesos ETL - Extraccin >IS.S3.C2.V4<

5. Procesos ETL Limpieza >IS.S3.C2.V5<

6. Procesos ETL Transformacin >IS.S3.C2.V6<

7. Procesos ETL - Carga >IS.S3.C2.V7<

8. Procesos ETL Ejemplo con datos >IS.S3.C2.V8<

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 20

Business Intelligence SAP Business Intelligence

Vdeo 5. Procesos ETL - Limpieza

Los sistemas transaccionales contienen datos que no han sido depurados y que deben ser

limpiados.

Las herramientas ETL tienen funcionalidades de limpieza de datos, aunque existen herramientas

especializadas para ello.

Pero cules son las causas que provocan que los datos estn sucios?, veamos algunos

ejemplos:

Valores por defecto.

Ausencia de valor. Campos con valores vacos.

Campos que tienen distintas utilidades: Para algunos clientes ponemos una

informacin y para otros, otra distinta. No homogeneizacin de los campos de la base

de datos.

Valores contradictorios.

Uso inapropiado de los campos, por ejemplo en las direcciones de los clientes.

Vulneracin de las reglas de negocio.

Duplicacin de claves primarias con valores que se haban utilizado en el pasado.

Etc.

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 21

Business Intelligence SAP Business Intelligence

Vdeo 5. Procesos ETL - Limpieza

La limpieza de datos se divide en las siguientes etapas:

Depuracin: Este proceso localiza e identifica los elementos individuales de informacin en las

fuentes de datos y los asla. Por ejemplo: separar el nombre completo en nombre, primer

apellido, segundo apellido, o la direccin en: calle, numero, piso, etc.

Correccin: Este proceso corrige los valores individuales de los atributos usando algoritmos de

correccin y fuentes de datos externas. Por ejemplo: comprueba una direccin y el cdigo postal

correspondiente.

Estandarizacin: Este proceso aplica rutinas de conversin para transformar valores en

formatos definidos (y consistentes) aplicando procedimientos de estandarizacin y definidos por

las reglas del negocio. Por ejemplo: trato de Sr., Sra., etc. o sustituyendo los diminutivos de

nombres por los nombres correspondientes.

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 22

Business Intelligence SAP Business Intelligence

Vdeo 5. Procesos ETL - Limpieza

Relacin: Este proceso busca y relaciona los valores de los registros, corrigindolos y

estandarizndolos, basndose en reglas de negocio para eliminar duplicados. Por ejemplo:

identificando nombres y direcciones similares.

Consolidacin: Este proceso analiza e identifica relaciones entre registros relacionados y los

junta en una sola representacin.

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 23

Business Intelligence SAP Business Intelligence

Vdeo 5. Procesos ETL - Limpieza

Datos de calidad

Qu se considera un dato de calidad?

La calidad de datos debe cumplir con los siguientes requisitos:

Unicidad: Relacionado con datos duplicados.

Uniformidad: Relacionado con irregularidades.

Exactitud: Los datos deben cumplir los requisitos de integridad, consistencia y densidad.

Consistencia: Alcanzado por la correccin de contradicciones y anomalas sintcticas.

Densidad: Conocer el cociente de valores omitidos sobre el nmero de valores totales.

Integridad: Los datos deben cumplir los requisitos de entereza y validez.

Entereza: Alcanzado por la correccin de datos que contienen anomalas.

Validez: Alcanzado por la cantidad de datos que satisfacen las restricciones.

Los procesos ETL son los encargados de garantizar el cumplimiento de las caractersticas

que deben cumplir los datos para ser considerados de calidad.

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 24

Business Intelligence SAP Business Intelligence

FINAL VIDEO 5

Procesos ETL - Limpieza

IS - Introduccin a SAP y Business Intelligence

Sesin 03 Introduccin a Business Intelligence

Clase 2 Componentes de BI (I)

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 25

Business Intelligence SAP Business Intelligence

CONTENIDO Sesin 3. Clase 2. Componentes de BI (I)

Videos

1. Esquema de BI >IS.S3.C2.V1<

2. Fuentes de datos >IS.S3.C2.V2<

3. Procesos ETL >IS.S3.C2.V3<

4. Procesos ETL - Extraccin >IS.S3.C2.V4<

5. Procesos ETL Limpieza >IS.S3.C2.V5<

6. Procesos ETL Transformacin >IS.S3.C2.V6<

7. Procesos ETL - Carga >IS.S3.C2.V7<

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 26

Business Intelligence SAP Business Intelligence

Vdeo 6. Procesos ETL - Transformacin

La fase de transformacin de un proceso de ETL aplica una serie de reglas de negocio o

funciones sobre los datos extrados para convertirlos en datos que sern aptos para ser

cargados en un almacn de datos determinado. Algunas fuentes de datos requerirn alguna

pequea manipulacin de los datos previa a la aplicacin de las reglas de negocio:

Seleccionar slo ciertas columnas para su carga (por ejemplo, que las columnas con valores

nulos no se carguen).

Traducir cdigos (por ejemplo, si la fuente almacena una H para Hombre y M para Mujer pero

el destino tiene que guardar 1 para Hombre y 2 para Mujer).

Codificar valores libres (por ejemplo, convertir Hombre en H o Sr en 1).

Obtener nuevos valores calculados (por ejemplo, total_venta = cantidad * precio).

Unir datos de mltiples fuentes (por ejemplo, bsquedas, combinaciones, etc.).

Calcular totales de mltiples filas de datos (por ejemplo, ventas totales de cada regin).

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 27

Business Intelligence SAP Business Intelligence

Vdeo 6. Procesos ETL - Transformacin

Generacin de campos clave en el destino.

Transponer o pivotar (girando mltiples columnas en filas o viceversa).

Dividir una columna en varias (por ejemplo, columna Nombre: Garca, Miguel; pasar a dos

columnas Nombre: Miguel y Apellido: Garca).

La aplicacin de cualquier forma, simple o compleja, de validacin de datos, y la consiguiente

aplicacin de la accin que en cada caso se requiera:

Datos OK: Entregar datos a la siguiente etapa (Carga).

Datos errneos: Ejecutar polticas de tratamiento de excepciones (por ejemplo, rechazar el

registro completo, dar al campo errneo un valor nulo o un valor centinela).

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 28

Business Intelligence SAP Business Intelligence

FINAL VIDEO 6

Procesos ETL - Transformacin

IS - Introduccin a SAP y Business Intelligence

Sesin 03 Introduccin a Business Intelligence

Clase 2 Componentes de BI (I)

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 29

Business Intelligence SAP Business Intelligence

CONTENIDO Sesin 3. Clase 2. Componentes de BI (I)

Videos

1. Esquema de BI >IS.S3.C2.V1<

2. Fuentes de datos >IS.S3.C2.V2<

3. Procesos ETL >IS.S3.C2.V3<

4. Procesos ETL - Extraccin >IS.S3.C2.V4<

5. Procesos ETL Limpieza >IS.S3.C2.V5<

6. Procesos ETL Transformacin >IS.S3.C2.V6<

7. Procesos ETL - Carga >IS.S3.C2.V7<

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 30

Business Intelligence SAP Business Intelligence

Vdeo 7. Procesos ETL - Carga

La carga es el momento en el que integramos los datos extrados con los residentes en el

datawarehouse, y debemos comprobar si, por ejemplo, los totales de ventas que hemos cargado

coinciden con la informacin que resida en nuestro sistema transaccional, as como si los valores

que tienen los registros cargados corresponden a los definidos en el datawarehouse. Es

fundamental comprobar que se ha desarrollado correctamente, ya que en caso contrario

pueden llevar a decisiones errneas a los usuarios.

Dependiendo de los requerimientos de la organizacin, este proceso puede abarcar una amplia

variedad de acciones diferentes. En casos se sobrescribe la informacin antigua con nuevos datos,

mientras que en otros la informacin se complementa.

Existen dos formas bsicas de desarrollar el proceso de carga:

Acumulacin simple: La acumulacin simple es la ms sencilla y comn, y consiste en realizar

un resumen de todas las transacciones comprendidas en el perodo de tiempo seleccionado y

transportar el resultado como una nica transaccin hacia el datawarehouse, almacenando un

valor calculado que consistir tpicamente en un sumatorio o un promedio de la magnitud

considerada.

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 31

Business Intelligence SAP Business Intelligence

Vdeo 7. Procesos ETL - Carga

Rolling: El proceso de Rolling por su parte, se aplica en los casos en que se opta por mantener

varios niveles de granularidad. Para ello se almacena informacin resumida a distintos niveles,

correspondientes a distintas agrupaciones de la unidad de tiempo o diferentes niveles

jerrquicos en alguna o varias de las dimensiones de la magnitud almacenada (por ejemplo,

totales diarios, totales semanales, totales mensuales, etc.).

Debido a la criticidad del proceso, las herramientas ETL son claves en los proyectos de BI. Es

indispensable que las herramientas de BI trabajen con datos de calidad. En caso contrario,

puede llevar a una toma de decisiones errnea.

Por este motivo, al realizar la carga se deben definir y aplicar todas las restricciones y triggers

(disparadores) que aseguren la integridad y consistencia de la informacin. Por ejemplo, valores

nicos, integridad referencial, campos obligatorios, rangos de valores. Estas restricciones y

triggers contribuyen a que se garantice la calidad de los datos en el proceso ETL.

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 32

Business Intelligence SAP Business Intelligence

FINAL VIDEO 7

Procesos ETL - Carga

IS - Introduccin a SAP y Business Intelligence

Sesin 03 Introduccin a Business Intelligence

Clase 2 Componentes de BI (I)

SAPBI Mster en Consultora IS - Introduccin a SAP y

Sesin 3 Clase 1 Pg. 33

Business Intelligence SAP Business Intelligence

Das könnte Ihnen auch gefallen

- Temario AngularDokument1 SeiteTemario AngularTonyPsNoch keine Bewertungen

- Curriculum Viate FrontendDokument2 SeitenCurriculum Viate FrontendTonyPsNoch keine Bewertungen

- Guía AWS Cloud Practitioner CLF-C01Dokument9 SeitenGuía AWS Cloud Practitioner CLF-C01AndresfvsNoch keine Bewertungen

- Constancia de Bachiller SuneduDokument1 SeiteConstancia de Bachiller SuneduTonyPs100% (2)

- Morales LJDokument279 SeitenMorales LJTonyPsNoch keine Bewertungen

- Dictamen #000252-2021-Upg-Vdip-Fisi-UnmsmDokument1 SeiteDictamen #000252-2021-Upg-Vdip-Fisi-UnmsmTonyPsNoch keine Bewertungen

- Assignments Js Fundamentals - En.esDokument23 SeitenAssignments Js Fundamentals - En.esTonyPsNoch keine Bewertungen

- Caso Practico 3Dokument128 SeitenCaso Practico 3Lore Lore Maju MajuNoch keine Bewertungen

- RNP AntonyDokument1 SeiteRNP AntonyTonyPsNoch keine Bewertungen

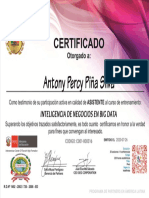

- Inteligencia de Negocios en Big DataDokument1 SeiteInteligencia de Negocios en Big DataTonyPsNoch keine Bewertungen

- INTELIGENCIA DE NEGOCIOS EN BIG DATA1 - ReduceDokument1 SeiteINTELIGENCIA DE NEGOCIOS EN BIG DATA1 - ReduceTonyPsNoch keine Bewertungen

- Arquitectura 1Dokument1 SeiteArquitectura 1TonyPsNoch keine Bewertungen

- Centro de capacitación en tecnologías informáticasDokument1 SeiteCentro de capacitación en tecnologías informáticasTonyPsNoch keine Bewertungen

- Administrador de Servidores de Base de DatosDokument1 SeiteAdministrador de Servidores de Base de DatosTonyPsNoch keine Bewertungen

- Auditoría TIC: Guía completa para auditar sistemas de información y comunicacionesDokument21 SeitenAuditoría TIC: Guía completa para auditar sistemas de información y comunicacionesTonyPsNoch keine Bewertungen

- Auditoria Ambiental 2019 PDFDokument94 SeitenAuditoria Ambiental 2019 PDFTonyPsNoch keine Bewertungen

- DownloadDokument28 SeitenDownloadTonyPsNoch keine Bewertungen

- Plan de Negocio PDFDokument19 SeitenPlan de Negocio PDFDonaldo Leonel Vargas AnguloNoch keine Bewertungen

- 1.indicador Rendimientos de Neumáticos Originales T1 - Enero 2018Dokument9 Seiten1.indicador Rendimientos de Neumáticos Originales T1 - Enero 2018TonyPsNoch keine Bewertungen

- Ejercicios de Conversión de Sistemas Trigonométricos para Quinto de SecundariaDokument5 SeitenEjercicios de Conversión de Sistemas Trigonométricos para Quinto de Secundariamibellagenio007100% (1)

- Manual para La Implementación de Un SGSSTDokument120 SeitenManual para La Implementación de Un SGSSTSayuri Julissa Herrera ChallcoNoch keine Bewertungen

- Lista de Documentos Montacargas.Dokument1 SeiteLista de Documentos Montacargas.TonyPsNoch keine Bewertungen

- Auditoría TIC: Guía completa para auditar sistemas de información y comunicacionesDokument21 SeitenAuditoría TIC: Guía completa para auditar sistemas de información y comunicacionesTonyPsNoch keine Bewertungen

- Auditoria Ambiental 2019 PDFDokument94 SeitenAuditoria Ambiental 2019 PDFTonyPsNoch keine Bewertungen

- Document PDFDokument55 SeitenDocument PDFTonyPsNoch keine Bewertungen

- Auditoría TIC: Guía completa para auditar sistemas de información y comunicacionesDokument21 SeitenAuditoría TIC: Guía completa para auditar sistemas de información y comunicacionesTonyPsNoch keine Bewertungen

- BUENAZADokument83 SeitenBUENAZATonyPsNoch keine Bewertungen

- Plantilla Matriz FODA PDFDokument1 SeitePlantilla Matriz FODA PDFTonyPs100% (1)

- Formato N 1Dokument1 SeiteFormato N 1TonyPsNoch keine Bewertungen

- Plan Seguridad CiudadanaDokument68 SeitenPlan Seguridad CiudadanaFreRo Rl GoOliNoch keine Bewertungen

- Parcial 1Dokument14 SeitenParcial 1Eduardo Montalvo del MonteNoch keine Bewertungen

- Costo Horario 2023Dokument30 SeitenCosto Horario 2023ANGEL JESUS VEGA REYESNoch keine Bewertungen

- Objetivos Estretegicos EjemploDokument3 SeitenObjetivos Estretegicos EjemploKarmelinJimenezNoch keine Bewertungen

- Roo PDFDokument57 SeitenRoo PDFJesús SixtecoNoch keine Bewertungen

- Caso Eco MeDokument23 SeitenCaso Eco Mejhonatan gutierrezNoch keine Bewertungen

- Errores Comunes en Las Camaras de SeguridadDokument44 SeitenErrores Comunes en Las Camaras de SeguridadAnonymous W3CwR8INoch keine Bewertungen

- HAZOPDokument11 SeitenHAZOPDiego PeñaNoch keine Bewertungen

- Lab OratorioDokument24 SeitenLab OratoriorcajoNoch keine Bewertungen

- Tarea 2 Administracion de Empresa 1Dokument5 SeitenTarea 2 Administracion de Empresa 1jose mosqueaNoch keine Bewertungen

- Administración de Operaciones y TecnologíaDokument5 SeitenAdministración de Operaciones y TecnologíaJosé De Jesús Figueroa Pereda0% (1)

- Presupuesto de Un Mantenimiento de TractoresDokument19 SeitenPresupuesto de Un Mantenimiento de Tractoresj.m.vilchesruz02Noch keine Bewertungen

- Costo de Soldadura OxiacetilenicaDokument12 SeitenCosto de Soldadura OxiacetilenicaJavierNoch keine Bewertungen

- Filtros para instalaciones de superficie YPFDokument35 SeitenFiltros para instalaciones de superficie YPFarmando0212-1Noch keine Bewertungen

- Herramientas de PresupuestosDokument71 SeitenHerramientas de PresupuestosAna Libia Pat PootNoch keine Bewertungen

- FT - White Fire X-50 IgnifufaDokument3 SeitenFT - White Fire X-50 IgnifufawaldoNoch keine Bewertungen

- Parcial 1 - Produccion IDokument4 SeitenParcial 1 - Produccion INadia Magali Ciccio50% (2)

- Curso ITF Fundamentos de ITIL 24 HorasDokument6 SeitenCurso ITF Fundamentos de ITIL 24 HorasJavier ToroNoch keine Bewertungen

- Caja Reductora Sincro ShutleDokument110 SeitenCaja Reductora Sincro ShutleLiliana Rebeca Santos santos100% (3)

- PlanSupervisiónInternaDokument5 SeitenPlanSupervisiónInternaCrisNoch keine Bewertungen

- Documents To Go Palm OsDokument6 SeitenDocuments To Go Palm OsCarlos CRNoch keine Bewertungen

- Taller 4 - CalidadDokument9 SeitenTaller 4 - CalidadISCONoch keine Bewertungen

- Logistica de EntradaDokument10 SeitenLogistica de EntradaLina Pino BetancurNoch keine Bewertungen

- Modos de FallaDokument6 SeitenModos de FallacarlosreyescasanovaNoch keine Bewertungen

- Caso John Deere Enunciado PDFDokument4 SeitenCaso John Deere Enunciado PDFPatitoNoch keine Bewertungen

- DOC031013 031020131727378uDokument252 SeitenDOC031013 031020131727378uDavid ecdloNoch keine Bewertungen

- OFICIALES OdtDokument29 SeitenOFICIALES OdtWillMan FernandezNoch keine Bewertungen

- Transporte y Transito DocenteDokument51 SeitenTransporte y Transito DocenteNelson Vidal Ruiz CcahuanaNoch keine Bewertungen

- Esp-AllweDokument62 SeitenEsp-AllweJonathan Eduardo Roman FernandezNoch keine Bewertungen

- CUBIC: armario modular sostenible con certificación ecodiseñoDokument3 SeitenCUBIC: armario modular sostenible con certificación ecodiseñoJavier CastilloNoch keine Bewertungen

- Arbol de Problemas en Base A La Matriz Marco Lógico Covid-19Dokument4 SeitenArbol de Problemas en Base A La Matriz Marco Lógico Covid-19Henry Tello Quinteros100% (1)